Embora mais barata e acessível, técnica de manipulação digital em áudio e vídeo é considerada complexa, o que dificulta produção em massa, explicam profissionais ouvidos pela CNN

A chegada do ano eleitoral eleva a preocupação de profissionais da segurança da informação com os vídeos deepfake — que alteram rostos e vozes de pessoas com resultados verossímeis, por meio de inteligência artificial. Consultados pela CNN, esses especialistas fazem uma ressalva: a técnica de manipulação é extremamente trabalhosa e complexa, o que dificulta sua produção massiva como ferramenta de desinformação nas eleições.

“[A alta disseminação] É algo mais hipotético do que real”, defende Mike Price, diretor de tecnologia da ZeroFox, companhia de segurança da informação que atua na detecção de deepfakes.

Segundo Price, que acompanha o avanço da tecnologia desde meados de 2017, o deepfake não tem sido usado de maneira intensa fora dos conteúdos adultos (montagens que colocam o rosto de mulheres em imagens pornográficas com o intuito de constranger a vítima, por exemplo), tanto que existem poucos dados de monitoramento e rastreamento disponíveis no mercado.

Price acredita que a enxurrada de formatos mais baratos, acessíveis e menos complexos de espalhar desinformação ajuda a explicar a “baixa produção” de vídeos deepfake.

“Você não precisa de um deepfake para manter uma operação de desinformação. E ainda que tenha um, precisará encontrar maneiras de espalhá-lo”, explica.

Pouco uso nas eleições americanas

Os especialistas ouvidos pela CNN lembram ainda o histórico das últimas eleições presidenciais nos EUA, em 2020, quando o uso de deepfakes foi muito menor do que o alardeado por analistas políticos.

Os principais usos ficaram basicamente restritos aos anúncios públicos sobre a possibilidade de eleitores serem enganados pelos efeitos especiais possíveis com a tecnologia, como fez Phil Ehr em 2019. Candidato democrata à Câmara da Flórida, a campanha de Ehr divulgou um anúncio com frases falsas, “ditas” por seu oponente, para explicitar o perigo desse tipo de manipulação.

Parte da falta de popularidade do uso de deepfake, segundo os que estão na vanguarda da confecção dessas chamadas “mídias sintéticas”, tem a ver com o fato de a tecnologia estar mais acessível, mas ainda não ser exatamente barata ou fácil de fazer.

“Há quem diga que ‘todo mundo pode fazer isso, é super simples’, mas não é bem assim. São necessários muitos recursos computacionais — como placas de vídeo e modelos de treinamento — para atingir um bom resultado. E também existe a qualidade da performance do ator. Miles [ator do Deep Tom Cruise] replica muito bem os maneirismos, a forma de andar e até voz de Tom Cruise”, explica Adjer sobre o famoso deepfake da Metaphysics.

Veja o vídeo abaixo feito com o deepfake de Tom Cruise:

“É muito mais barato do que produzir um filme tradicional, mas ainda é algo caro”, concorda Cristóbal Ross, fundador da Deepmaster, que lançou no início deste ano o filme “Una película de Zombies”, totalmente gravado com deepfakes. Para se ter uma ideia do custo de uma produção do tipo, Ross passou oito meses coordenando um time de pós-produção de oito pessoas para editar mais de 500 mil frames de vídeo.

Henry Adjer, diretor de Políticas e Parcerias da Metaphysic, pondera ser possível fazer um deepfake “ruim” ou “mal feito” ser mais crível — reduzindo a qualidade e resolução dos vídeos —, mas reforça que não é preciso usar tanta tecnologia para criar uma situação de desinformação.

Ele cita como exemplo o caso de um vídeo da presidente da Câmara Nancy Pelosi que, ao ser desacelerado, dava a entender que a líder democrata estava bêbada enquanto discursava.

“Eu ficaria surpreso de ver nas eleições brasileiras um deepfake crítico que pudesse minar o processo democrático de forma significativa, que pudesse virar votos ou fazer um candidato desistir. Alternativas mais baratas, rápidas e eficientes de manipulação me parecem mais prováveis de serem utilizadas por pessoas mal intencionadas”, defende Adjer, que também estudou o tema na academia.

Representante do Instituto de Pesquisa do Recife (IP.rec), o advogado André Fernandes tem acompanhado o assunto muito de perto e concorda que o custo da produção deve ser considerado.

“Quem quer espalhar desinformação também acaba fazendo uma equação econômica do projeto. Por que gastar quatro vezes mais [criando um deepfake] se o que eu exploro não é a imagem [de quem é manipulado], mas a confiança das pessoas?”, provoca.

Olhos pouco treinados

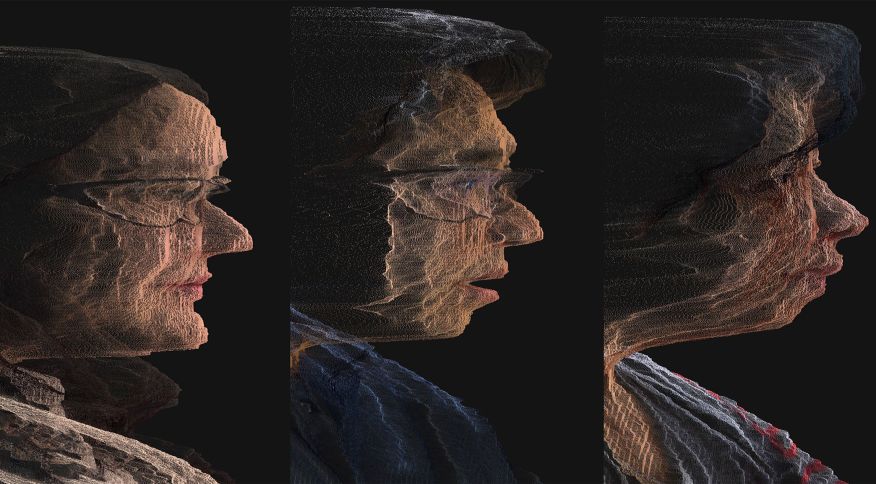

Definir o que é real e o que é falso está cada vez mais trabalhoso no ambiente digital. O hiper-realismo e a qualidade visual dos deepfakes, aliados a olhos pouco treinados ou que desconhecem a tecnologia, tornam quase impossível, em alguns casos, distinguir um deepfake de um material autêntico.

De acordo com pesquisa recente da empresa de segurança digital Kaspersky, 66% dos brasileiros não sabem o que é um deepfake, enquanto 7 em cada 10 não saberiam reconhecer um vídeo que tenha utilizado a técnica inovadora.

“O fato de a maioria das pessoas estar predisposta a acreditar em um vídeo ou áudio criado digitalmente, por não saberem que é possível fazer tal coisa, facilita o êxito de campanhas de desinformação ou golpes online que utilizem tais técnicas [de deepfake]”, explica Fabio Assolini, analista sênior de segurança da Kaspersky.

Apoiados em técnicas de inteligência artificial e aprendizado de máquina, capazes de manipular conteúdos de áudio e vídeo de maneira convincente, os deepfakes conseguem criar experiências que podem facilmente se passar como verdade.

Um exemplo recente é o deepfake do ator Tom Cruise, criado pela Metaphysic, que interage com a audiência na conta DeepTomCruise no TikTok. A imitação do ator foi uma maneira encontrada pela companhia de demonstrar o potencial da tecnologia para a indústria de entretenimento — que pode empregá-la em efeitos especiais e melhor uso de dublês, por exemplo.

Além disso, há a expectativa de que a tecnologia será parte importante dos bastidores dos metaversos, ambientes virtuais que propõem a interação entre avatares.

Com o deepfake, os avatares poderão ser muitíssimo semelhantes a seus seus usuários.

“As mídias sintéticas serão as engrenagens do metaverso”, promete Henry Adjer, em entrevista à CNN, poucos dias depois da empresa receber um investimento de US$ 7,5 milhões.

O futuro dos deepfakes

Quem pesquisa e trabalha com deepfake tem discutido há algum tempo os desafios éticos e as próximas aplicações da tecnologia, que tendem a ser um sucesso tremendo não apenas na indústria audiovisual e de entretenimento, mas também no nascente metaverso.

Que tipos de estragos uma ferramenta de deepfake pode causar e como mitigar esse risco? A resposta ainda paira no ar, segundo especialistas, mas há alguns caminhos. Seja o controle de acesso a tais ferramentas, uso de marcas d’água e indicativos visuais em deepfakes ou até a transparência informativa, como é o caso da conta do Deep Tom Cruise — que já no nome do perfil informa se tratar de um fake.

Nada disso impede, contudo, o uso da tecnologia de forma maliciosa, E, por isso, Henry Adjer acredita que o entendimento do contexto e a alfabetização midiática são essenciais. “Quando você assiste a ‘Jurassic Park’, é desnecessário uma marca d’água indicando que aquilo é um efeito especial”.

Adjer também lembra que a falsificação é algo que acontece diversas vezes, em diversas mídias, ao longo da história — e seria quase inevitável evitá-la.

“Precisamos nos preparar para um mundo em que a mídia sintética fará parte das nossas vidas. E, de certa forma, ela já faz, e está presente nos filtros nas mídias sociais, na fotografia computacional, na publicidade, na TV e no entretenimento — e isso deve aumentar cada vez mais “, defende o pesquisador e executivo da Metaphysic.

Nesse sentido, uma certa massificação do uso da tecnologia deepfake no entretenimento pode auxiliar a entender que não se pode ter uma suspensão da descrença com conteúdos em vídeo que recebemos nos nossos celulares da mesma forma que fazemos diante dos efeitos especiais do cinema.

Um dos exemplos mais citados pelos especialistas entrevistados pela CNN foi o trabalho do comediante brasileiro e expert em deepfakes Bruno Sartori, que faz uso da tecnologia para criar paródias, inclusive de sátira política.

“Ele tem um trabalho que é informativo, que faz uma alerta, mas que mantém a pegada mais crítica”, defende a advogada Evelyn Melo Silva, que desde 2019 acompanha o avanço das deepfakes.

Para manter o público e o eleitorado em alerta, Evelyn defende que o Tribunal Superior Eleitoral (TSE) retome a estratégia de educação digital usada durante as últimas eleições, de 2020, quando veiculou em TV aberta campanhas sobre deepfakes e fake news.

“Partimos da premissa de que os celulares e os planos de dados são acessíveis [para fazer a checagem de informações], mas essa não é a realidade nacional”, alerta a advogada. Ela lembra que o recebimento de informações acontece de maneira gratuita em mensageiros instantâneos, mas a checagem ainda exige o consumo do plano de dados de boa parte dos brasileiros.

“Não adianta falar em educação [midiática] sem conceder instrumentos de acesso à informação”, pontua.

Falta de regulamentação

Em termos legais, os deepfakes flutuam em uma zona cinzenta de falta de regulamentação. Segundo a interpretação de Evelyn Melo Silva, que atua em direito eleitoral, nem mesmo deepfakes criados com autorização dos candidatos — por exemplo, para agilizar a confecção de materiais de campanha — seriam considerados legais.

Eles esbarraram no conceito de “trucagem” estabelecido na lei 9.504, que proíbe o uso de “montagens” em campanhas políticas, seja para ridicularizar ou beneficiar um candidato.

“Considerando uma interpretação fria da lei, a legislação não permitiria. No entanto, essa tecnologia não existia na época em que essa definição foi feita, então não existia esse debate, e a interpretação da lei pode variar conforme o tempo”, pondera a advogada.

Como identificar um deepfake?

Ao receber um vídeo que pareça suspeito, pause e observe atentamente a imagem. E tente buscar os seguintes indícios:

1. Contorno do rosto de cores diferentes

No contorno do rosto, é possível perceber diferenças de tonalidade na cor de pele? O principal desafio da pós produção de deepfakes tem a ver com suavizar a transição entre o desenho do rosto do chamado “host” (o ator ou pessoa que terá o rosto substituído) e a personalidade que está sendo imitada.

2. Acessórios que não combinam

Observe com cuidado acessórios, como brincos — muitas vezes, os deepfakes substituem as jóias apenas de um dos lados da orelha, deixando o personagem descombinando.

3. Atenção aos olhos

O padrão de piscadas dos deepfakes pode ficar esquisito e inconsistente.

4. Óculos são mais difíceis de manipular

“Se quiser proteger uma pessoa de ser transformada em deepfake, ponha um óculos nela”, sugeriu Cristóbal Ross, da Deepmaster. Os reflexos da lente são difíceis de replicar ou remover nos deepfakes e podem ser indícios de fraude.

![kym-ellis-af1npsndqlw-unsplash[1] kym-ellis-af1npsndqlw-unsplash[1]](https://revistaatencao.s3.sa-east-1.amazonaws.com/wp-content/uploads/2026/02/28132105/kym-ellis-af1npsndqlw-unsplash1.jpg)